本站原创文章,转载请说明来自《老饼讲解-深度学习》www.bbbdata.com

局部响应归一化LRN(Local Response Normalization)是AlexNet原文提供的一种归一化方法

本文讲解LRN归一化的计算公式,以及通过具体例子讲解LRN的计算方法,以助于理解LRN是如何计算的

通过本文可以快速了解LRN是什么,LRN的思路是什么,LRN有什么用,以及LRN具体是怎么计算的

本节介绍什么是局部响应归一化及具体的计算公式

局部响应归一化LRN是什么

LRN全称为Local Response Normalization,即局部响应归一化

LRN是一种深度学习中的一种归一化方法,由AlexNet卷积神经网络的原文提出并使用

但由于后续的多张论文,使用LRN后都没什么效果,且计算复杂,现一般都已被BN归一化方法替代

可以说,LRN完全没有学习的必要,但为了某些非想知道LRN是什么的同学,所以笔者还是写了本文

LRN局部响应归一化的计算公式

LRN在AlexNet原文的公式如下:

其中

:第i个通道(x,y)位置的值

:第i个通道(x,y)位置归一化后的值

:局部归一化的半径,原文n设为

:通道数,就是通道的最大索引

:待设参数

原文设为

局部响应归一化LRN-具体例子解说

LRN的意图是指将卷积结果按通道进行局部归一化

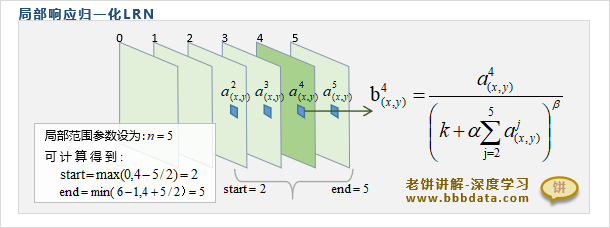

举例如下,设有6个通道(序号为0至5),则第4通道位置(x,y)的值归一化方法如下

将第4通道(x,y)位置的值与邻近通道同位置的值进行一起归一化

即归一化后的值为:

解说:范围"2->5"是如何确定的?它由局部范围参数n=5来确定

由于在第4通道,以4为中心抓取n=5个通道(即2、3、4、5、6),但6已经超出通道范围,故得到"2->5"

老饼语

AlexNet本身是贡献卓越的,AlexNet中使用的各项技术都因为AlexNet而发扬光大

但唯独AlexNet论文自创的LRN并没有发扬光大,

因为后续的多张论文,使用LRN后都没什么效果,而且计算复杂

因此,LRN基本除了当年AlexNet自身使用,之后基本都没再出现

取而代之的是后来提出的批归一化BN

可以说,LRN完全没有学习的必要,但为了某些非想知道LRN是什么的同学,所以笔者还是写了本文

好了,以上就是局部响应归一化LRN的讲解了~

End

评论

评论